昆仑万维刚开源了个多模态模型,叫Skywork UniPic,走的是自回归路线。这模型厉害的地方在于,一个架构里就把图像理解、文本生图、图像编辑这三块核心能力捏合到一起了。

训练的时候用了大规模高质量数据,端到端练出来的,通用性和可迁移性都挺强。

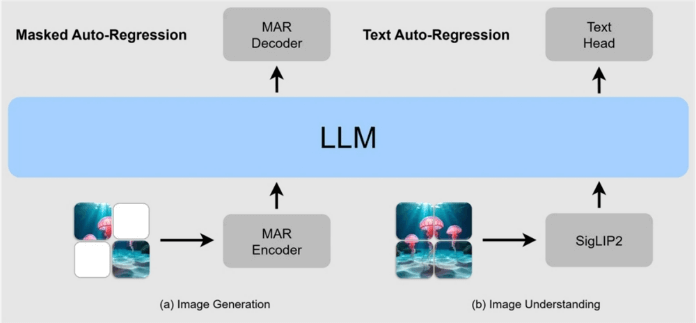

技术上有点东西。它用了MAR编码器和SigLIP2主干网络,避开了传统多模态模型依赖VQ或VAE编码器的坑——那些老方法容易丢语义信息。现在这么一搞,跨任务协同顺畅多了。

实际用起来也方便,输入提示词就能同时搞定一堆事。比如生成指定场景的图,或者给图像做风格化编辑,不用在不同工具之间切来切去。

参数规模1.5B,却能跑出接近大型统一模型的效果。试了下指令遵循、复杂生图和图像编辑这些测试,表现都是行业前排的。

最香的是门槛低,消费级显卡就能流畅跑。像我们这种手头没高端设备的开发者,调试起来也不用心疼显卡资源,迭代模型的时候省了不少麻烦。

能做到这一步,跟它的数据体系、专用Reward Model优化还有渐进式多任务训练策略分不开。用高效能语料库加分层分辨率训练,平衡了性能和效率,没掉进传统方法里“顾此失彼”的技术陷阱。

这次开源也是昆仑万维推进AI普惠的一步,之前他们就开源过不少领域的大模型。现在Skywork UniPic补上了创意工具这块,对想上手的人很友好。

模型权重:https://huggingface.co/Skywork/Skywork-UniPic-1.5B

技术报告:https://github.com/SkyworkAI/UniPic/blob/main/UNIPIC.pdf

需要的话,模型权重、技术报告、代码仓库都能直接拿。权重在huggingface上,技术报告和代码仓库在github,链接都放出来了,肝项目的时候直接扒下来用就行。